Probé la transcripción de una entrevista en inglés con IA — Resultados del 26 de febrero de 2026 (Whisper BASE, ~11 minutos de audio)

2026-02-26Test

Eric King

Author

1. Por qué este benchmark de entrevista importa

En entrevistas reales, la precisión de la transcripción no es opcional. Determina si puedes citar a tus invitados con seguridad, buscar temas clave y construir análisis posteriores sin tergiversar lo que se dijo. Un adjetivo omitido, un número mal escuchado o un nombre propio distorsionado pueden cambiar el significado de una respuesta.

En este benchmark utilicé un fragmento de entrevista en inglés con “Bill”, lo pasé por una canalización de transcripción basada en Whisper y lo evalué con métricas ASR estándar. El objetivo no es hacer marketing, sino ofrecer una instantánea concreta y reproducible de cómo se comporta el sistema en una entrevista real de longitud moderada.

El audio original de la entrevista procede de un vídeo de YouTube, que puedes consultar como contexto:

Vídeo original de la entrevista en YouTube.

Vídeo original de la entrevista en YouTube.

Source Materials

Todas las entradas utilizadas en este benchmark están en el repositorio o en recursos estáticos y se pueden inspeccionar directamente:

- Audio original: Audio source

- Transcripción de referencia (VTT): Base text

- Transcripción del modelo (VTT): Result text

Estos archivos son las únicas fuentes utilizadas para derivar las cifras y conclusiones de este artículo.

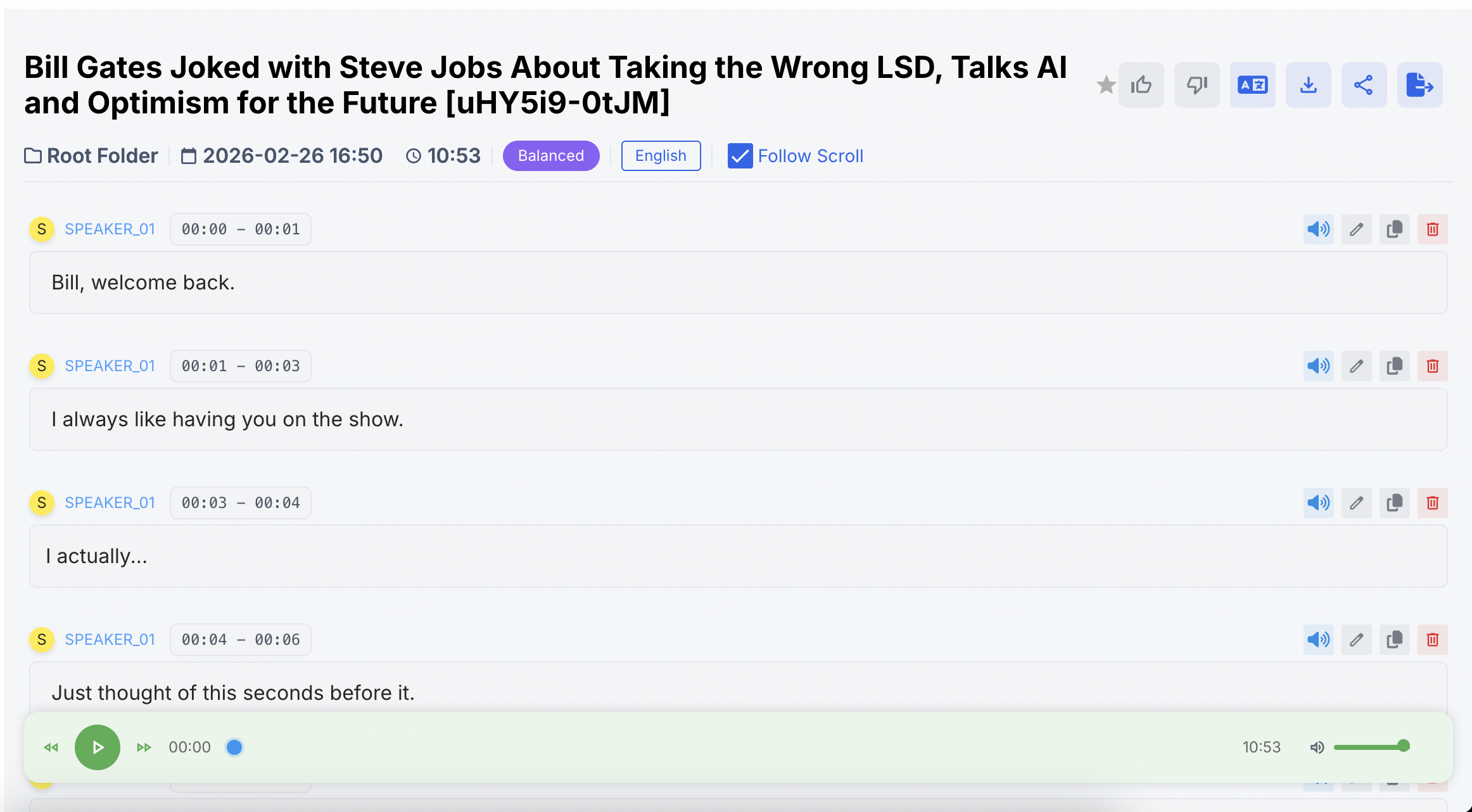

Screenshots from this run

2. Configuración de la prueba (Testing Setup)

Para esta ejecución se utilizó la siguiente configuración (todos los valores proceden de las metadatos precomputadas y de

result.json):- Fecha de la prueba: 2026‑02‑26 (derivada de las marcas de tiempo de procesamiento)

- Escenario: entrevista en inglés (

test-transcripts/bill-interview) - Idioma: inglés

- Duración del audio:

audioDurationSeconds = 653.2934375- ≈ 10,89 minutos de material

- Tiempo de procesamiento:

sttProcessingTimeSeconds = 85.476- ≈ 1,42 minutos de decodificación extremo a extremo

- Modelo / modo:

whisper-model: BASEsaytowords-mode: base

Las condiciones de grabación, el tipo de micrófono y la densidad del habla no están documentadas en las metadatos, así que prefiero no inventarlas ni hacer suposiciones. Todo el alineamiento y el scoring se realizaron antes de redactar este informe; las cifras que aparecen a continuación se leen directamente de

test-transcripts/bill-interview/result.json.3. Metodología de evaluación (Evaluation Methodology)

Tanto la transcripción humana de referencia (

ref.vtt) como la salida del modelo (model.vtt) se almacenan en formato WebVTT. El pipeline de evaluación extrae primero texto plano, después alinea referencia e hipótesis y, por último, calcula las métricas de error.Word Error Rate (WER)

Tras tokenizar en secuencias de palabras, contamos:

- (S): sustituciones

- (D): supresiones (deletions)

- (I): inserciones

- (N): número total de palabras de referencia

La tasa de error de palabras se define como:

[

\text{WER} = \frac{S + D + I}{N}

]

La precisión a nivel palabra (Accuracy) se obtiene como:

[

\text{Accuracy} = 1 - \text{WER}

]

Character Error Rate (CER)

A nivel de carácter, se eliminan los espacios y se calcula una distancia de edición tipo Levenshtein:

- Distancia de edición de caracteres: suma de inserciones, supresiones y sustituciones

- Total de caracteres: número de caracteres de referencia (sin espacios)

[

\text{CER} = \frac{\text{Character edit distance}}{\text{Total characters}}

]

Real‑Time Factor (RTF)

El throughput se mide con el Real‑Time Factor:

[

\text{RTF} = \frac{\text{Processing Time}}{\text{Audio Duration}}

]

Aquí, el tiempo de procesamiento se obtiene de la diferencia entre

processtime-at y completed-at en other.yaml, y la duración del audio procede de audio-duration en el mismo archivo.Notas de implementación

- Todas las métricas se calculan a partir de un alineamiento entre referencia e hipótesis.

- Las distancias de edición (a nivel de palabra y de carácter) utilizan una implementación Levenshtein de alto rendimiento.

- El motor de alineamiento se ejecuta sobre un backend optimizado en C++.

- La complejidad temporal es de O(nm) para secuencias de longitudes (n) y (m).

- Todos los valores de

result.jsonson deterministas y reproducibles: mismas entradas ⇒ mismos resultados.

4. Descripción general del modelo (Model Overview)

En este benchmark se evaluó una única configuración de modelo:

- Whisper BASE (saytowords-mode: base)

Un modelo de reconocimiento de voz de propósito general, con capacidad media, diseñado para inglés multiacento y audio de larga duración. En este benchmark se utiliza tal cual (sin fine‑tuning ni correcciones manuales) para observar su comportamiento bruto en una entrevista real.

En el futuro se podrían comparar variantes más pequeñas o más grandes de Whisper, así como sistemas no basados en Whisper, pero este artículo se centra en caracterizar esta única baseline.

5. Resultados (a partir de result.json)

Los valores siguientes se toman directamente de

test-transcripts/bill-interview/result.json:- Duración de audio (s):

653.2934375 - Tiempo de procesamiento (s):

85.476 - Palabras de referencia (N):

1846 - Sustituciones (S):

67 - Supresiones (D):

178 - Inserciones (I):

23 - WER:

0.14517876489707476 - Accuracy:

0.8548212351029252 - Caracteres de referencia:

7335 - Distancia de edición de caracteres:

825 - CER:

0.11247443762781185 - RTF:

0.13083860191079907

En forma más legible:

- WER ≈ 14,52 %

- Accuracy ≈ 85,48 %

- CER ≈ 11,25 %

- RTF ≈ 0,13, es decir, aproximadamente 7,6× más rápido que en tiempo real.

6. Análisis del patrón de errores (Error Pattern Analysis)

No se proporcionan marcas de error por segmento ni visualizaciones adicionales; el análisis se basa por completo en los totales agregados.

-

Tipo de error dominante: supresiones (deletions)

- Supresiones:

D = 178 - Sustituciones:

S = 67 - Inserciones:

I = 23

Las supresiones constituyen la mayoría de los errores a nivel de palabra. Esto indica que el modelo tiende a omitir palabras más que a inventar contenido. En el contexto de una entrevista, esto suele traducirse en palabras funcionales que desaparecen, finales de frase truncados cuando se habla rápido o fragmentos omitidos cuando varias personas hablan a la vez.

- Supresiones:

-

Las sustituciones existen, pero son secundarias

ConS = 67, las sustituciones representan alrededor de una cuarta parte de todos los errores. Suelen corresponder a confusiones léxicas: palabras de sonido parecido, nombres mal reconocidos o términos de dominio poco frecuentes para el modelo. -

Las inserciones son relativamente escasas

Sólo se observanI = 23inserciones. Esto es coherente con un modelo conservador en cuanto a alucinaciones de contenido: se equivoca más por omisión que por adición.

A nivel de carácter:

- Distancia de edición de caracteres = 825 sobre 7335 caracteres, lo que da CER ≈ 11,25 %.

Comparada con una WER de ~14,5 %, esta CER más baja sugiere que muchos de los términos erróneos siguen siendo cercanos a la referencia a nivel de caracteres, por ejemplo ligeras variaciones de flexión, pequeñas faltas de ortografía o palabras compuestas concatenadas/separadas de otra forma.

Sin anotaciones de error por timestamp, no podemos señalar «el momento exacto de la entrevista donde el modelo falla». Sin embargo, la descomposición S/D/I ya ofrece un perfil útil: este sistema tiende más a subtranscribir (under‑transcribe) que a inventar fragmentos que no existen.

7. Conclusiones clave (Key Insights)

Partiendo únicamente de las métricas numéricas, se pueden extraer varias conclusiones:

-

Buen equilibrio entre velocidad y precisión para entrevistas

Con RTF ≈ 0,13, el sistema procesa ~10,9 minutos de audio en ~1,4 minutos, manteniendo WER ≈ 14,5 % y CER ≈ 11,3 %. Para el procesamiento masivo de entrevistas, este punto de operación es razonable. -

Perfil de error claramente dominado por supresiones

Las supresiones (178) dominan claramente sobre las sustituciones (67) y las inserciones (23). En la práctica, esto significa que es más probable perder pequeños fragmentos de contenido que ver al modelo inventar frases completas. -

Mayor estabilidad a nivel de carácter que de palabra

Que la CER sea menor que la WER indica que muchas palabras incorrectas siguen siendo similares a la referencia a nivel de caracteres. Esto es positivo para tareas como la búsqueda o el clustering temático, que toleran variaciones léxicas moderadas. -

Volumen de habla no trivial

Con 1846 palabras de referencia y 7335 caracteres, este escenario se parece mucho más a una entrevista real que a un ejemplo de juguete. Las métricas reflejan el comportamiento sostenido sobre varios minutos de habla espontánea.

8. Mejor modelo para este escenario (Best Model for This Scenario)

En este benchmark sólo se evaluó Whisper BASE (modo base), por lo que es, al mismo tiempo:

- el modelo más fuerte del «cuadro», y

- el único punto de referencia.

En este marco, ofrece:

- WER ≈ 14,5 %, Accuracy ≈ 85,5 % sobre ~11 minutos de audio de entrevista.

- RTF ≈ 0,13, es decir, 7–8× más rápido que en tiempo real.

Para flujos de trabajo que necesitan transcripciones de entrevistas rápidas y razonablemente precisas —para navegar, buscar o citar de forma aproximada— esta configuración es numéricamente adecuada. Para casos en los que cada palabra debe ser perfecta, estas métricas dejan claro que sigue siendo necesaria la revisión humana o un modelo más potente.

9. Veredicto final neutro (Neutral Final Verdict)

En esta entrevista en inglés del 26 de febrero de 2026, Whisper BASE en modo «base» muestra:

- un perfil de error dominado por supresiones, con muy pocas inserciones,

- una WER en torno al rango medio de los diez y tantos y una CER en los bajos diez y tantos, apoyadas en una transcripción de referencia no trivial,

- un Real‑Time Factor alrededor de 0,13, adecuado para procesamiento por lotes a gran escala.

Su comportamiento es numéricamente consistente, reproducible y lo bastante rápido para servir como base de benchmarks diarios. Para un evaluador independiente, el mensaje es claro: esta configuración es una baseline viable para la transcripción de entrevistas, pero aún no sustituye la revisión humana en dominios muy sensibles.

Artefactos de referencia (Reference Artifacts)

A continuación se muestran estructuras plegables para la transcripción de referencia y la del modelo. Puedes insertar en ellas el contenido completo de los VTT si lo necesitas.

ref.vtt (transcripción de referencia)

<!-- Pega aquí el contenido completo de test-transcripts/bill-interview/ref.vtt -->

model.vtt (transcripción del modelo)

<!-- Pega aquí el contenido completo de test-transcripts/bill-interview/model.vtt -->