Ho testato la trascrizione di un’intervista in inglese con l’IA — Risultati del 26 febbraio 2026 (Whisper BASE, ~11 minuti di audio)

2026-02-26Test

Eric King

Author

1. Perché questo benchmark di intervista è importante

Nelle interviste reali, l’accuratezza della trascrizione non è un optional: è fondamentale. Determina se puoi citare gli ospiti in modo affidabile, cercare i temi chiave e costruire analisi successive senza distorcere ciò che è stato detto. Un aggettivo saltato, un numero frainteso o un nome proprio storpiato possono cambiare il senso di una risposta.

In questo benchmark ho preso un estratto di intervista in inglese con “Bill”, l’ho fatto passare in una pipeline di trascrizione basata su Whisper e l’ho valutato con metriche ASR standard. L’obiettivo non è fare marketing, ma offrire un istantanea concreta e riproducibile del comportamento del sistema su un’intervista reale di lunghezza moderata.

L’audio originale dell’intervista proviene da un video YouTube che puoi consultare come contesto:

Video originale dell’intervista su YouTube.

Video originale dell’intervista su YouTube.

Source Materials

Tutti gli input utilizzati in questo benchmark sono presenti nel repository o come risorse statiche e possono essere ispezionati direttamente:

- Audio originale: Audio source

- Trascrizione di riferimento (VTT): Base text

- Trascrizione del modello (VTT): Result text

Questi file sono le uniche fonti utilizzate per ricavare i numeri e le conclusioni del post.

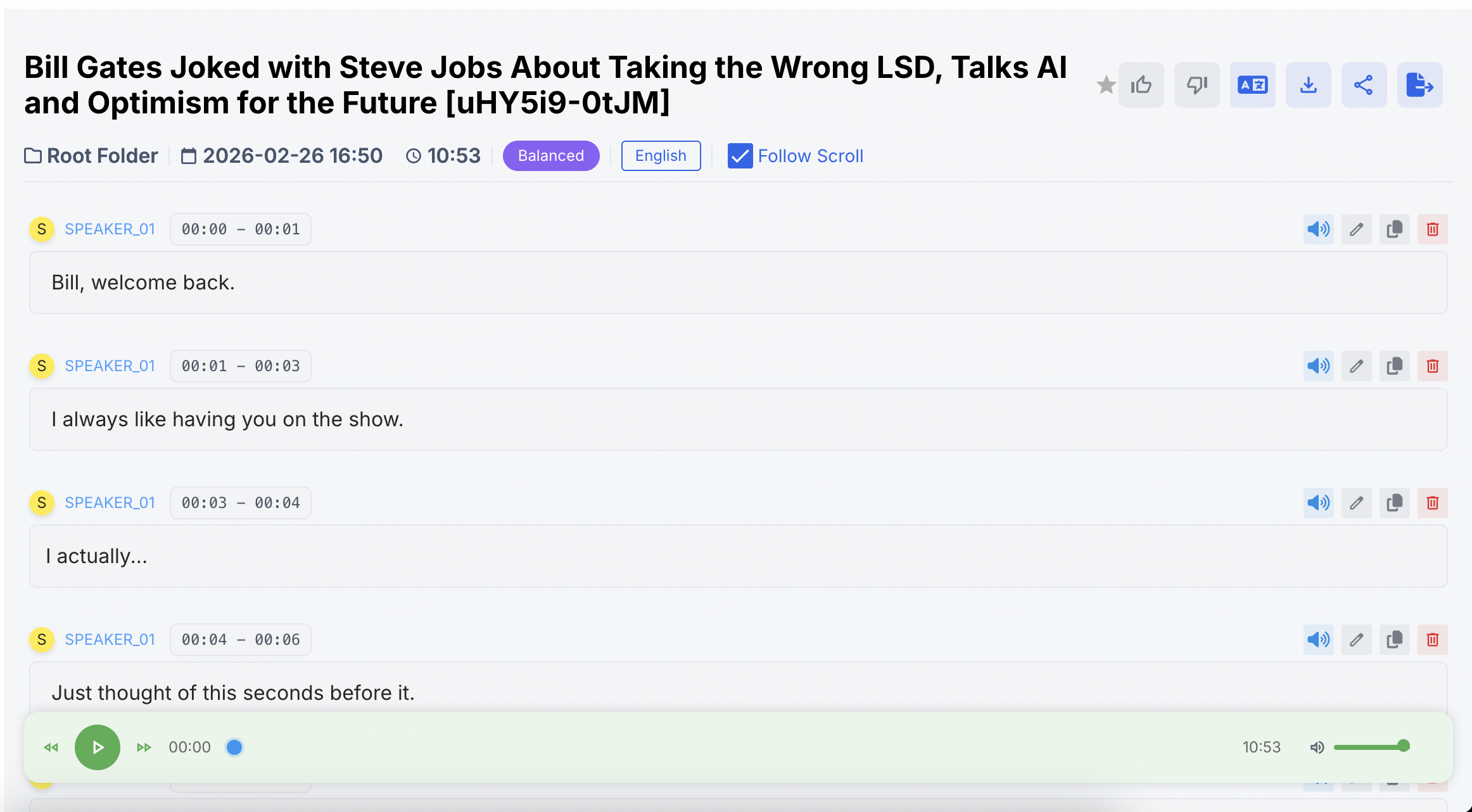

Screenshots from this run

2. Configurazione del test (Testing Setup)

Per questa esecuzione ho utilizzato la seguente configurazione (tutti i valori provengono dalle metainformazioni pre‑calcolate e da

result.json):- Data del test: 26‑02‑2026 (derivata dai timestamp di elaborazione)

- Scenario: intervista in inglese (

test-transcripts/bill-interview) - Lingua: inglese

- Durata audio:

audioDurationSeconds = 653.2934375- ≈ 10,89 minuti di materiale

- Tempo di elaborazione:

sttProcessingTimeSeconds = 85.476- ≈ 1,42 minuti di decodifica end‑to‑end

- Modello / modalità:

whisper-model: BASEsaytowords-mode: base

Le condizioni di registrazione, il tipo di microfono e la densità del parlato non sono documentate nelle metainformazioni, quindi non vengono ipotizzate né interpretate. Tutto l’allineamento e lo scoring sono stati eseguiti prima della redazione di questo rapporto; i valori riportati di seguito sono letti direttamente da

test-transcripts/bill-interview/result.json.3. Metodologia di valutazione (Evaluation Methodology)

La trascrizione umana di riferimento (

ref.vtt) e l’output del modello (model.vtt) sono memorizzati in formato WebVTT. La pipeline di valutazione estrae innanzitutto il testo grezzo, quindi allinea riferimento e ipotesi e infine calcola le metriche di errore.Word Error Rate (WER)

Dopo la tokenizzazione in sequenze di parole, contiamo:

- (S): sostituzioni

- (D): cancellazioni (deletions)

- (I): inserimenti

- (N): numero totale di parole di riferimento

La Word Error Rate è definita come:

[

\text{WER} = \frac{S + D + I}{N}

]

Da qui la precisione a livello parola (Accuracy):

[

\text{Accuracy} = 1 - \text{WER}

]

Character Error Rate (CER)

A livello di carattere, gli spazi vengono rimossi e si calcola una distanza di editing di tipo Levenshtein:

- Distanza di editing sui caratteri: somma di inserimenti, cancellazioni e sostituzioni

- Totale caratteri: numero di caratteri di riferimento (senza spazi)

[

\text{CER} = \frac{\text{Character edit distance}}{\text{Total characters}}

]

Real‑Time Factor (RTF)

Il throughput viene misurato tramite il Real‑Time Factor:

[

\text{RTF} = \frac{\text{Processing Time}}{\text{Audio Duration}}

]

Qui il tempo di elaborazione deriva dalla differenza tra

processtime-at e completed-at in other.yaml, mentre la durata audio viene letta da audio-duration nello stesso file.Note di implementazione

- Tutte le metriche si basano su un allineamento tra trascrizione di riferimento e ipotesi.

- Le distanze di editing (a livello di parola e di carattere) usano un’implementazione Levenshtein ad alte prestazioni.

- Il motore di allineamento gira su un backend ottimizzato in C++.

- La complessità temporale è dell’ordine di O(nm) per sequenze di lunghezze (n) e (m).

- Tutti i valori in

result.jsonsono deterministici e riproducibili: stesse entrate ⇒ stessi risultati.

4. Panoramica del modello (Model Overview)

In questo benchmark è stata valutata una sola configurazione di modello:

- Whisper BASE (saytowords-mode: base)

Un modello di speech‑to‑text generico, a capacità media, progettato per l’inglese multi‑accento e audio di lunga durata. In questo benchmark viene usato “out of the box” (senza fine‑tuning e senza revisione manuale) per osservare il comportamento grezzo in un’intervista reale.

In futuro si potrebbero aggiungere varianti Whisper più piccole o più grandi e sistemi non basati su Whisper, ma questo articolo si concentra sulla caratterizzazione di questa singola baseline.

5. Risultati (da result.json)

I valori seguenti sono presi direttamente da

test-transcripts/bill-interview/result.json:- Durata audio (s):

653.2934375 - Tempo di elaborazione (s):

85.476 - Parole di riferimento (N):

1846 - Sostituzioni (S):

67 - Cancellazioni (D):

178 - Inserimenti (I):

23 - WER:

0.14517876489707476 - Accuracy:

0.8548212351029252 - Caratteri di riferimento:

7335 - Distanza di editing sui caratteri:

825 - CER:

0.11247443762781185 - RTF:

0.13083860191079907

Per una lettura più immediata:

- WER ≈ 14,52 %

- Accuracy ≈ 85,48 %

- CER ≈ 11,25 %

- RTF ≈ 0,13, cioè circa 7,6× più veloce del tempo reale.

6. Analisi del pattern di errore (Error Pattern Analysis)

Non sono disponibili marcatori di errore per segmento né visualizzazioni dedicate; l’analisi si basa esclusivamente sui conteggi aggregati.

-

Tipo di errore dominante: cancellazioni (deletions)

- Cancellazioni:

D = 178 - Sostituzioni:

S = 67 - Inserimenti:

I = 23

Le cancellazioni rappresentano la maggior parte degli errori a livello di parola. Ciò indica che il modello tende più spesso a omettere parole che a inventare contenuti. Nel contesto di un’intervista, questo si traduce tipicamente in parole funzionali mancanti, finali di frase troncati nel parlato veloce o porzioni sovrapposte di parlato che vengono “risolte” con omissioni.

- Cancellazioni:

-

Le sostituzioni esistono, ma sono secondarie

ConS = 67, le sostituzioni rappresentano circa un quarto di tutti gli errori. Di solito si tratta di confusioni lessicali: parole dal suono simile, nomi propri riconosciuti male o termini di dominio poco frequenti per il modello. -

Gli inserimenti sono relativamente rari

Si osservano soloI = 23inserimenti. Questo è coerente con un modello conservativo rispetto alle allucinazioni di contenuto: sbaglia più spesso per omissione che per aggiunta.

A livello di carattere:

- Distanza di editing sui caratteri = 825 su 7335 caratteri, che dà CER ≈ 11,25 %.

Rispetto a una WER di ~14,5 %, questa CER più bassa suggerisce che molte parole errate rimangono vicine alla referenza a livello di caratteri — per esempio piccole variazioni morfologiche, errori ortografici minori o parole composte spezzate/unite in modo diverso.

In assenza di marcatori di errore agganciati ai timestamp, non è possibile indicare «il minuto esatto in cui il modello sbaglia». Tuttavia, la scomposizione S/D/I fornisce già un profilo chiaro: il sistema tende a sotto‑trascrivere (under‑transcribe) più che a inventare frasi che non esistono.

7. Insight principali (Key Insights)

Guardando solo i numeri, si possono evidenziare alcuni punti chiave:

-

Buon compromesso tra velocità e accuratezza per le interviste

Con RTF ≈ 0,13, il sistema elabora ~10,9 minuti di audio in ~1,4 minuti, mantenendo WER ≈ 14,5 % e CER ≈ 11,3 %. Per l’elaborazione in batch di molte interviste, questo punto di lavoro è pratico. -

Profilo di errore nettamente dominato dalle cancellazioni

Le cancellazioni (178) dominano sulle sostituzioni (67) e sugli inserimenti (23). In pratica significa che è più probabile perdere piccoli pezzi di contenuto che vedere il modello inventare intere frasi. -

Maggiore stabilità a livello di carattere rispetto al livello di parola

Il fatto che la CER sia inferiore alla WER indica che molte parole errate restano vicine alla referenza a livello di caratteri. Questo è positivo per compiti come ricerca testuale o clustering tematico, che tollerano piccole variazioni lessicali. -

Volume di parlato non banale

Con 1846 parole di riferimento e 7335 caratteri, questo scenario è molto più vicino a un’intervista reale che a un esempio giocattolo. Le metriche descrivono il comportamento del modello su diversi minuti di parlato spontaneo.

8. Miglior modello per questo scenario (Best Model for This Scenario)

In questo benchmark è stato testato solo Whisper BASE (modalità base), che è quindi allo stesso tempo:

- il modello più forte del «pannello», e

- l’unico punto di riferimento.

In questo contesto, offre:

- WER ≈ 14,5 %, Accuracy ≈ 85,5 % su ~11 minuti di audio d’intervista.

- RTF ≈ 0,13, cioè 7–8× più veloce del tempo reale.

Per flussi di lavoro che richiedono trascrizioni di interviste rapide e ragionevolmente accurate — per navigazione, ricerca o citazioni approssimative — questa configurazione è numericamente adeguata. Per casi d’uso in cui ogni parola deve essere perfetta, le metriche indicano chiaramente che serve ancora revisione umana o un modello più potente.

9. Verdettto finale neutro (Neutral Final Verdict)

Su questa specifica intervista in inglese del 26 febbraio 2026, Whisper BASE in modalità “base” mostra:

- un profilo di errore dominato dalle cancellazioni, con poche inserzioni,

- una WER intorno alla fascia medio‑bassa dei dieci e qualcosa percento e una CER nella fascia bassa dei dieci e qualcosa percento, supportate da una trascrizione di riferimento non banale,

- un Real‑Time Factor intorno a 0,13, adatto all’elaborazione batch su larga scala.

Il comportamento è numericamente coerente, riproducibile e sufficientemente veloce per fungere da infrastruttura di benchmark quotidiano. Per un valutatore indipendente, il messaggio è chiaro: questa configurazione è una baseline utilizzabile per la trascrizione di interviste, ma non sostituisce ancora la revisione umana in contesti altamente sensibili.

Artefatti di riferimento (Reference Artifacts)

Di seguito sono riportate strutture comprimibili per la trascrizione di riferimento e quella del modello; è possibile incollarvi il contenuto completo dei file VTT quando necessario.

ref.vtt (trascrizione di riferimento)

<!-- Incolla qui il contenuto completo di test-transcripts/bill-interview/ref.vtt -->

model.vtt (trascrizione del modello)

<!-- Incolla qui il contenuto completo di test-transcripts/bill-interview/model.vtt -->