영어 인터뷰를 AI로 받아써 봤습니다 — 2026년 2월 26일 결과 (Whisper BASE, 약 11분 오디오)

2026-02-26Test

Eric King

Author

1. 왜 이 인터뷰 벤치마크가 중요한가

실제 인터뷰에서 전사 정확도는 선택 사항이 아니라 필수 조건입니다. 게스트 발언을 안전하게 인용할 수 있는지, 중요한 주제를 안정적으로 검색할 수 있는지, 후속 분석이 발언 내용을 왜곡하지 않고 이뤄질 수 있는지가 모두 전사 품질에 달려 있습니다. 형용사 하나가 빠지거나, 숫자를 잘못 듣거나, 고유명사가 이상하게 바뀌면 답변의 의미가 크게 달라질 수 있습니다.

이번 벤치마크에서는 “Bill 인터뷰” 영어 클립을 Whisper 기반 전사 파이프라인에 통과시킨 뒤, 표준 ASR 지표로 성능을 평가했습니다. 목표는 마케팅이 아니라, 실제 중간 길이 인터뷰에서 시스템이 어떻게 동작하는지에 대한 구체적이고 재현 가능한 스냅샷을 제공하는 것입니다.

원본 인터뷰 오디오는 YouTube 영상에 해당하며, 컨텍스트 확인용으로 시청할 수 있습니다:

YouTube 원본 인터뷰 영상.

YouTube 원본 인터뷰 영상.

Source Materials

이번 벤치마크에 사용된 모든 입력은 리포지토리 또는 정적 리소스로 공개되어 있으며, 직접 확인할 수 있습니다.

- 원본 오디오: Audio source

- 레퍼런스 전사 (VTT): Base text

- 모델 전사 결과 (VTT): Result text

이 글에서 사용하는 모든 수치와 결론은 위 파일들에만 기반합니다.

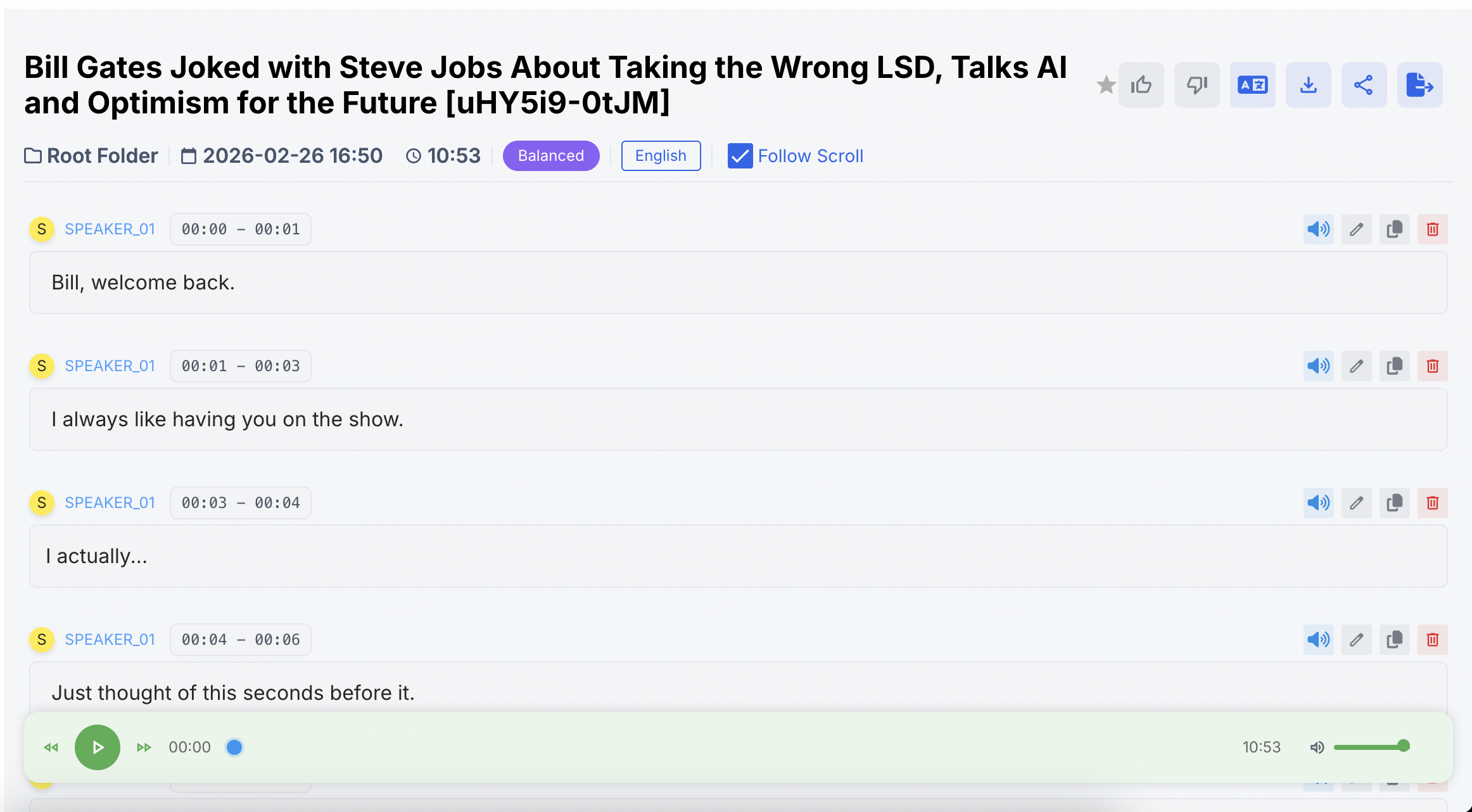

Screenshots from this run

2. 테스트 설정 (Testing Setup)

이번 실험의 설정은 다음과 같습니다. (모든 값은 사전에 계산된 메타데이터 및

result.json 에서 가져왔습니다.)- 실행 날짜: 2026‑02‑26 (처리 타임스탬프에서 도출)

- 시나리오: 영어 인터뷰 (

test-transcripts/bill-interview) - 언어: 영어

- 오디오 길이:

audioDurationSeconds = 653.2934375- 약 10.89분 분량

- 처리 시간:

sttProcessingTimeSeconds = 85.476- 약 1.42분 엔드투엔드 디코딩 시간

- 모델 / 모드:

whisper-model: BASEsaytowords-mode: base

녹음 환경, 마이크 종류, 발화 밀도 등은 메타데이터에 명시되어 있지 않으므로, 여기서 추측하거나 보강하지 않습니다. 정렬(alignment) 및 점수 계산은 이 보고서를 작성하기 전에 완료되었으며, 이후에 등장하는 숫자는 모두

test-transcripts/bill-interview/result.json 에서 직접 읽어온 값입니다.3. 평가 방법 (Evaluation Methodology)

사람이 작성한 레퍼런스 전사(

ref.vtt)와 모델 출력(model.vtt)은 모두 WebVTT 형식으로 저장되어 있습니다. 평가 파이프라인은 먼저 이들 파일에서 순수 텍스트를 추출한 뒤, 레퍼런스와 가설(hypothesis)을 정렬하고, 그 결과를 바탕으로 여러 오류 지표를 계산합니다.Word Error Rate (WER)

텍스트를 단어 시퀀스로 토큰화한 후 다음을 계산합니다.

- (S): 치환 오류 (substitutions)

- (D): 삭제 오류 (deletions)

- (I): 삽입 오류 (insertions)

- (N): 레퍼런스 전사에 포함된 총 단어 수

Word Error Rate는 다음 식으로 정의됩니다.

[

\text{WER} = \frac{S + D + I}{N}

]

여기서 단어 단위 **정확도(Accuracy)**는 다음과 같습니다.

[

\text{Accuracy} = 1 - \text{WER}

]

Character Error Rate (CER)

문자 단위에서는 공백을 제거한 뒤, Levenshtein 기반 편집 거리를 계산합니다.

- 문자 편집 거리: 삽입·삭제·치환의 합계

- 총 문자 수: 레퍼런스 전사(공백 제외)의 문자 수

[

\text{CER} = \frac{\text{Character edit distance}}{\text{Total characters}}

]

Real‑Time Factor (RTF)

처리 속도는 Real‑Time Factor로 측정합니다.

[

\text{RTF} = \frac{\text{Processing Time}}{\text{Audio Duration}}

]

여기서 Processing Time은

other.yaml 내 processtime-at과 completed-at의 차이, Audio Duration은 같은 파일의 audio-duration 값입니다.구현 관련 메모

- 모든 지표는 레퍼런스와 가설 간의 정렬 결과를 기반으로 계산됩니다.

- 단어·문자 레벨 편집 거리는 모두 고성능 Levenshtein 구현을 사용해 계산합니다.

- 정렬 엔진은 C++ 최적화 백엔드 위에서 동작합니다.

- 시퀀스 길이가 (n), (m)일 때 시간 복잡도는 대략 O(nm) 입니다.

result.json의 값은 모두 결정적이고 재현 가능하며, 동일 입력에 대해서는 항상 동일한 결과가 나옵니다.

4. 모델 개요 (Model Overview)

이번 벤치마크에서 평가한 모델 구성은 하나입니다.

- Whisper BASE (saytowords-mode: base)

중간 규모의 용량을 가진 범용 Speech‑to‑Text 모델로, 다양한 억양의 영어와 비교적 긴 오디오를 처리하는 것을 목표로 합니다. 이번 테스트에서는 별도의 파인튜닝이나 수동 교정을 하지 않고 기본 설정 그대로 사용해, 실제 인터뷰 상황에서의 “있는 그대로의” 동작을 관찰했습니다.

향후에는 더 작거나 더 큰 Whisper 변형, Whisper가 아닌 모델과의 비교도 가능하지만, 본 글은 이 단일 베이스라인을 중심으로話를 전개합니다.

5. 결과 요약 (result.json 기준)

다음 값들은 모두

test-transcripts/bill-interview/result.json에서 그대로 가져온 것입니다.- 오디오 길이(초):

653.2934375 - 처리 시간(초):

85.476 - 레퍼런스 단어 수 (N):

1846 - 치환(S):

67 - 삭제(D):

178 - 삽입(I):

23 - WER:

0.14517876489707476 - Accuracy:

0.8548212351029252 - 레퍼런스 문자 수:

7335 - 문자 편집 거리:

825 - CER:

0.11247443762781185 - RTF:

0.13083860191079907

해석하기 쉽게 정리하면 다음과 같습니다.

- WER ≈ 14.52%

- Accuracy ≈ 85.48%

- CER ≈ 11.25%

- RTF ≈ 0.13, 즉 실시간의 약 7.6배 속도로 처리

6. 오류 패턴 분석 (Error Pattern Analysis)

이번 평가에는 세그먼트별 오류 시각화나 타임스탬프 단위 라벨이 제공되지 않으므로, 아래 분석은 전적으로 집계된 수치에 기반합니다.

-

주요 오류 유형: 삭제(deletions)

- 삭제:

D = 178 - 치환:

S = 67 - 삽입:

I = 23

단어 레벨 오류 대부분이 삭제입니다. 이는 모델이 새로운 내용을 만들어내기보다는 단어를 빠뜨리는 쪽으로 더 많이 실수한다는 뜻입니다. 인터뷰 맥락에서는 기능어가 빠지거나, 빠른 발화에서 문장 끝 부분이 잘리거나, 여러 화자가 겹치는 부분이 생략되는 형태로 나타날 수 있습니다.

- 삭제:

-

치환 오류는 존재하지만 2순위

S = 67로 전체 오류의 약 1/4을 차지합니다. 비슷한 발음의 단어 혼동, 잘못 인식된 고유명사, 모델이 자주 접하지 못한 도메인 용어 등이 대표적인 사례입니다. -

삽입 오류는 비교적 드물다

삽입은I = 23건에 불과합니다. 이는 모델이 콘텐츠를 “지어내는” 경향이 크지 않다는 의미로, 필요 이상으로 많은 단어를 추가하기보다는 일부 내용을 누락시키는 쪽에 더 치우쳐 있음을 보여줍니다.

문자 레벨에서는 다음과 같습니다.

- 문자 편집 거리 = 825, 레퍼런스 문자 수 = 7335 → CER ≈ 11.25%

약 14.5% 수준의 WER과 비교했을 때 더 낮은 CER은, 많은 오단어가 문자 단위에서는 레퍼런스와 상당히 유사하다는 뜻입니다. 즉, 어미 변화, 경미한 스펠링 차이, 합성어의 분리·결합 방식 차이 등, 완전히 엉뚱한 단어라기보다는 “비슷하지만 다른” 경우가 많다는 의미입니다.

타임스탬프 단위의 에러 마킹이 없으므로, 인터뷰 중 정확히 어느 시점에서 모델이 실패했는지를 직접 지적할 수는 없습니다. 하지만 S/D/I 분해만으로도 이 시스템이 under‑transcribe 쪽(조금 덜 써주는 쪽) 으로 기우는 경향이 뚜렷하다는 점은 충분히 드러납니다.

7. 핵심 인사이트 (Key Insights)

숫자만 놓고 봐도 몇 가지 중요한 시사점을 정리할 수 있습니다.

-

인터뷰 용도에서 속도–정확도 밸런스는 양호한 편

RTF ≈ 0.13 상태에서 약 10.9분 분량 오디오를 약 1.4분 만에 처리하면서, WER ≈ 14.5% / CER ≈ 11.3% 를 유지합니다. 대량의 인터뷰 전사 작업을 배치로 처리하기에는 충분히 현실적인 지점입니다. -

오류 분포가 삭제에 크게 치우쳐 있음

삭제(178)가 치환(67)과 삽입(23)보다 훨씬 많습니다. 실제 운용에서는 모델이 내용을 덜 써주는 쪽으로 실수할 가능성이 크고, 완전히 새로운 문장을 지어낼 가능성은 상대적으로 낮다는 뜻입니다. -

단어 수준보다 문자 수준에서 안정성이 높다

CER이 WER보다 낮다는 점은, 많은 오단어가 문자 단위에서는 레퍼런스와 꽤 가까운 형태를 유지하고 있음을 시사합니다. 이는 어느 정도의 어형·철자 변화를 허용할 수 있는 검색·주제 클러스터링 등의 작업에 긍정적인 특성입니다. -

“장난감” 수준이 아닌 음성량을 대상으로 한 평가

1846개 레퍼런스 단어, 7335개 문자는 짧은 예문 몇 줄이 아니라, 실제 인터뷰에 가까운 분량입니다. 이 벤치마크의 수치는 수 분에 걸친 자발적 발화 전반에 대한 평균적인 거동을 반영합니다.

8. 이 시나리오에서의 “최고” 모델 (Best Model for This Scenario)

이번 벤치마크에서는 **Whisper BASE (base 모드)**만 테스트했습니다. 따라서 이 모델은 동시에,

- 이 «표»에서 가장 강한 모델이자

- 유일한 기준점입니다.

이 전제를 두었을 때, 모델은 다음과 같은 성능을 보입니다.

- 약 11분 분량 인터뷰 오디오에서 WER ≈ 14.5%, Accuracy ≈ 85.5%

- RTF ≈ 0.13, 즉 실시간의 7–8배 속도로 추론 가능

컨텐츠 브라우징, 검색, 대략적인 인용을 위한 인터뷰 전사처럼, “빠르고 꽤 믿을 만한” 정도의 결과가 필요한 워크플로에서는 이 구성이 수치적으로 충분히 쓸 만합니다. 반대로, 단어 하나도 틀리면 안 되는 용도라면, 이 지표들이 보여주듯 여전히 사람 검수 또는 더 강력한 모델이 필요합니다.

9. 중립적인 최종 평가 (Neutral Final Verdict)

2026년 2월 26일 기준 이 영어 인터뷰 데이터셋에서, base 모드 Whisper BASE는 다음과 같은 특성을 보였습니다.

- 삽입은 적고 삭제가 우세한 오류 프로파일,

- 장난감이 아닌 레퍼런스 전사에 대해 10%대 중반 WER 및 10%대 초반 CER,

- 대규모 배치 처리에 적합한 약 0.13 수준의 Real‑Time Factor.

행동은 수치적으로 일관되고 재현 가능하며, 일상적인 벤치마크 용도로는 충분히 빠릅니다. 제3자 평가자의 관점에서 요약하면, 이 구성은 영어 인터뷰 전사 작업을 위한 유효한 베이스라인이지만, 민감도가 아주 높은 도메인에서 사람 검수를 완전히 대체할 수준에는 아직 이르지 않았다고 볼 수 있습니다.

참고 아티팩트 (Reference Artifacts)

아래에는 레퍼런스 전사와 모델 전사 결과를 접어서 볼 수 있는 영역을 미리 정의해 두었습니다. 필요하다면 VTT 파일 전체 내용을 그대로 붙여 넣어 사용할 수 있습니다.

ref.vtt (레퍼런스 전사)

<!-- 여기 test-transcripts/bill-interview/ref.vtt 전체 내용을 붙여 넣으세요 -->

model.vtt (모델 전사)

<!-- 여기 test-transcripts/bill-interview/model.vtt 전체 내용을 붙여 넣으세요 -->