Ik heb AI‑transcriptie getest op een Engels interview — Resultaten van 26 februari 2026 (Whisper BASE, ~11 minuten audio)

2026-02-26Test

Eric King

Author

1. Waarom deze interview‑benchmark ertoe doet

Bij echte interviews is transcriptienauwkeurigheid geen luxe, maar een basisvereiste. Zij bepaalt of je gasten veilig kunt citeren, of je belangrijke thema’s terugvindt en of latere analyses de inhoud niet verdraaien. Een gemist bijvoeglijk naamwoord, een verkeerd gehoord getal of een verhaspelde eigennaam kan de betekenis van een antwoord veranderen.

In deze benchmark heb ik een Engels “Bill‑interview”‑fragment door een Whisper‑gebaseerde transcriptie‑pipeline gehaald en geëvalueerd met standaard ASR‑metriek. Het doel is niet marketing, maar een concreet, reproduceerbaar snapshot van hoe het systeem zich gedraagt op een echt, middel‑lang interview.

Het originele interviewaudio komt uit een YouTube‑video die je als context kunt bekijken:

Broninterview op YouTube.

Broninterview op YouTube.

Source Materials

Alle inputs voor deze benchmark staan in de repository of als statische resources en zijn direct te inspecteren:

- Originele audio: Audio source

- Referentietranscript (VTT): Base text

- Modeltranscript (VTT): Result text

Deze bestanden zijn de enige bronnen voor alle cijfers en conclusies in dit artikel.

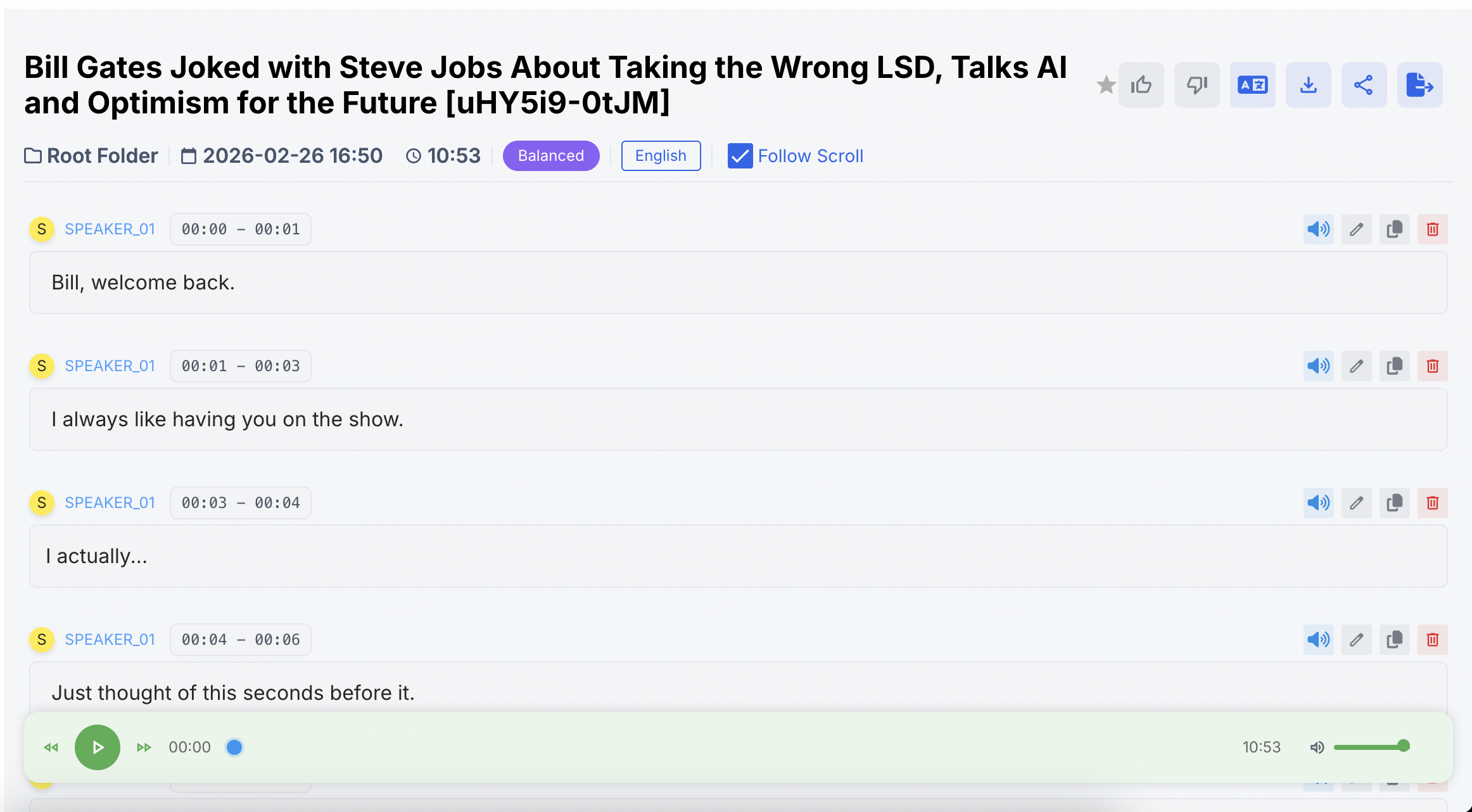

Screenshots from this run

2. Testopstelling (Testing Setup)

Voor deze run is de volgende configuratie gebruikt (alle waarden komen uit de voor‑berekende metadata en

result.json):- Datum van de run: 26‑02‑2026 (afgeleid uit verwerkingstimestamps)

- Scenario: Engels interview (

test-transcripts/bill-interview) - Taal: Engels

- Audioduur:

audioDurationSeconds = 653.2934375- ≈ 10,89 minuten materiaal

- Verwerkingstijd:

sttProcessingTimeSeconds = 85.476- ≈ 1,42 minuten end‑to‑end decoding

- Model / modus:

whisper-model: BASEsaytowords-mode: base

Opnamecondities, microfoontype en spreeksnelheid zijn niet gedocumenteerd in de metadata, dus daarover wordt niet gespeculeerd. Alle alignments en scoring zijn voorafgaand aan dit verslag uitgevoerd; de onderstaande getallen worden direct uit

test-transcripts/bill-interview/result.json gelezen.3. Evaluatiemethodiek (Evaluation Methodology)

Zowel het menselijke referentietranscript (

ref.vtt) als de modeloutput (model.vtt) zijn opgeslagen in WebVTT‑formaat. De evaluatiepipeline extraheert eerst platte tekst, lijnt vervolgens referentie en hypothese uit en berekent daarna de foutmetriek.Word Error Rate (WER)

Na tokenisatie naar woordsequenties tellen we:

- (S): substitutions

- (D): deletions

- (I): insertions

- (N): aantal referentiewoorden

De Word Error Rate is gedefinieerd als:

[

\text{WER} = \frac{S + D + I}{N}

]

De woordnauwkeurigheid (Accuracy) volgt hieruit als:

[

\text{Accuracy} = 1 - \text{WER}

]

Character Error Rate (CER)

Op tekenniveau worden spaties verwijderd en wordt een Levenshtein‑edit‑afstand berekend:

- Bewerkingafstand op tekenniveau: totaal aantal inserties, deleties en substituties

- Totaal aantal tekens: aantal referentietekens (zonder spaties)

[

\text{CER} = \frac{\text{Character edit distance}}{\text{Total characters}}

]

Real‑Time Factor (RTF)

De verwerkingssnelheid wordt gemeten met de Real‑Time Factor:

[

\text{RTF} = \frac{\text{Processing Time}}{\text{Audio Duration}}

]

Hier komt de verwerkingstijd uit het verschil tussen

processtime-at en completed-at in other.yaml, en de audioduur uit audio-duration in hetzelfde bestand.Implementatienotities

- Alle metriek wordt berekend op basis van een alignment tussen referentie en hypothese.

- Zowel woord‑ als tekenafstand maken gebruik van een high‑performance Levenshtein‑implementatie.

- De alignmentengine draait op een C++‑geoptimaliseerde backend.

- De tijdcomplexiteit is van orde O(nm) bij sequentielengten (n) en (m).

- Alle waarden in

result.jsonzijn deterministisch en reproduceerbaar: dezelfde input ⇒ dezelfde output.

4. Modeloverzicht (Model Overview)

In deze benchmark is één modelconfiguratie geëvalueerd:

- Whisper BASE (saytowords-mode: base)

Een algemeen inzetbaar speech‑to‑text‑model met middelgrote capaciteit, ontworpen voor Engels met meerdere accenten en langere audio. In deze test wordt het model onveranderd gebruikt (zonder fine‑tuning, zonder handmatige correctie) om het ruwe gedrag op een echt interview te observeren.

Toekomstige vergelijkingen kunnen kleinere of grotere Whisper‑varianten en niet‑Whisper‑systemen toevoegen, maar dit artikel focust op deze ene baseline.

5. Resultaten (uit result.json)

De volgende waarden komen rechtstreeks uit

test-transcripts/bill-interview/result.json:- Audioduur (s):

653.2934375 - Verwerkingstijd (s):

85.476 - Referentiewoorden (N):

1846 - Substitutions (S):

67 - Deletions (D):

178 - Insertions (I):

23 - WER:

0.14517876489707476 - Accuracy:

0.8548212351029252 - Referentietekens:

7335 - Character edit distance:

825 - CER:

0.11247443762781185 - RTF:

0.13083860191079907

Samengevat in meer leesbare vorm:

- WER ≈ 14,52 %

- Accuracy ≈ 85,48 %

- CER ≈ 11,25 %

- RTF ≈ 0,13, dus ongeveer 7,6× sneller dan realtime.

6. Analyse van het foutpatroon (Error Pattern Analysis)

Er zijn geen tijdsegment‑labels of aanvullende visualisaties beschikbaar; de analyse is volledig gebaseerd op geaggregeerde aantallen.

-

Dominante foutsoort: deletions

- Deletions:

D = 178 - Substitutions:

S = 67 - Insertions:

I = 23

Deletions vormen het grootste deel van de woorderros. Dit wijst erop dat het model eerder woorden weglaat dan inhoud verzint. In een interviewcontext betekent dit vaak dat functiewoorden verdwijnen, zinsstaarten bij snelle spraak worden afgekapt of delen van overlappende spraak worden genegeerd.

- Deletions:

-

Substitutions zijn aanwezig maar secundair

MetS = 67maken substitutions ongeveer een kwart van alle fouten uit. Typische voorbeelden zijn lexicale verwarringen: gelijk klinkende woorden, verkeerd herkende namen of domeinspecifieke termen die het model minder vaak heeft gezien. -

Insertions zijn relatief zeldzaam

Er zijn slechtsI = 23insertions. Dat past bij een model dat conservatief is ten opzichte van hallucinaties: het maakt vaker fouten door weglating dan door toevoeging.

Op tekenniveau:

- Character edit distance = 825 bij 7335 tekens, wat neerkomt op CER ≈ 11,25 %.

In vergelijking met een WER van ~14,5 % suggereert deze lagere CER dat veel foutieve woorden op tekenniveau nog redelijk dicht bij de referentie liggen — bijvoorbeeld door lichte verbuigingsverschillen, kleine spelfouten of anders gesplitste/samengevoegde samenstellingen.

Zonder tijdgebaseerde foutlabels kunnen we geen specifieke probleemmomenten aanwijzen. Toch geeft de S/D/I‑verdeling al een duidelijk beeld: dit systeem neigt eerder tot under‑transcribe dan tot het verzinnen van nieuwe zinnen.

7. Belangrijkste inzichten (Key Insights)

Puur op basis van de cijfers vallen een paar hoofdpunten op:

-

Goede balans tussen snelheid en nauwkeurigheid voor interviews

Met RTF ≈ 0,13 verwerkt het systeem ~10,9 minuten audio in ~1,4 minuut, terwijl WER ≈ 14,5 % en CER ≈ 11,3 % blijven. Voor bulkverwerking van interviews is dat een werkbaar punt. -

Foutpatroon sterk gedomineerd door deletions

Deletions (178) domineren over substitutions (67) en insertions (23). In de praktijk betekent dit dat je eerder kleine stukjes inhoud verliest dan dat het model hele zinnen verzint. -

Meer stabiliteit op teken‑ dan op woordniveau

De lagere CER ten opzichte van WER laat zien dat veel foutieve woorden op tekenniveau nog dicht bij de referentie liggen. Dat is gunstig voor taken als zoeken en thematische clustering, die kleine lexicale afwijkingen toestaan. -

Niet‑triviale hoeveelheid spraak

Met 1846 referentiewoorden en 7335 tekens ligt dit veel dichter bij een echt interview dan bij een speelgoedvoorbeeld. De metriek beschrijft gedrag over meerdere minuten spontane spraak.

8. Beste model voor dit scenario (Best Model for This Scenario)

In deze benchmark is uitsluitend Whisper BASE (base mode) getest, waardoor het tegelijk:

- het sterkste model op de «ranglijst» is, en

- het enige referentiepunt.

Binnen deze context levert het:

- WER ≈ 14,5 %, Accuracy ≈ 85,5 % op ~11 minuten interviewaudio,

- RTF ≈ 0,13, oftewel 7–8× sneller dan realtime.

Voor workflows die snelle, redelijk nauwkeurige interviewtranscripten nodig hebben — bijvoorbeeld om te browsen, zoeken of globaal te citeren — is deze configuratie numeriek voldoende. Voor situaties waarin elk woord telt, maken de metriek duidelijk dat handmatige review of een sterker model nog steeds nodig is.

9. Neutraal eindoordeel (Neutral Final Verdict)

Op dit specifieke Engelse interview van 26 februari 2026 laat Whisper BASE in “base”‑modus zien:

- een foutprofiel dat wordt gedomineerd door deletions, met weinig insertions,

- een WER in de midden‑tien procent en een CER in de lage tien procent, onderbouwd door een niet‑triviaal referentietranscript,

- een Real‑Time Factor rond 0,13, geschikt voor batchverwerking op grote schaal.

Het gedrag is numeriek consistent, reproduceerbaar en snel genoeg voor dagelijkse benchmarks. Voor een onafhankelijke evaluator is de conclusie helder: deze configuratie is een bruikbare baseline voor interviewtranscriptie, maar nog geen vervanging voor menselijke controle in zeer gevoelige domeinen.

Referentie‑artefacten (Reference Artifacts)

Hieronder staan inklapbare blokken voor het referentie‑ en modeltranscript; je kunt hier indien gewenst de volledige VTT‑inhoud plaatsen.

ref.vtt (referentietranscript)

<!-- Plak hier de volledige inhoud van test-transcripts/bill-interview/ref.vtt -->

model.vtt (modeltranscript)

<!-- Plak hier de volledige inhoud van test-transcripts/bill-interview/model.vtt -->