Testei a transcrição de uma entrevista em inglês com IA — Resultados de 26 de fevereiro de 2026 (Whisper BASE, ~11 minutos de áudio)

2026-02-26Test

Eric King

Author

1. Por que este benchmark de entrevista é importante

Em entrevistas reais, a precisão da transcrição não é um detalhe: é essencial. Ela determina se você pode citar convidados com segurança, buscar temas importantes e construir análises posteriores sem distorcer o que foi dito. Um adjetivo omitido, um número ouvido errado ou um nome próprio deformado podem mudar o sentido de uma resposta.

Neste benchmark, usei um trecho de entrevista em inglês com “Bill”, passei por um pipeline de transcrição baseado em Whisper e avaliei com métricas ASR padrão. O objetivo não é marketing, e sim fornecer um retrato concreto e reproduzível de como o sistema se comporta em uma entrevista real de duração moderada.

O áudio original da entrevista vem de um vídeo do YouTube, que você pode consultar para ter o contexto:

Vídeo original da entrevista no YouTube.

Vídeo original da entrevista no YouTube.

Source Materials

Todas as entradas usadas neste benchmark estão no repositório ou em recursos estáticos e podem ser inspecionadas diretamente:

- Áudio original: Audio source

- Transcrição de referência (VTT): Base text

- Transcrição do modelo (VTT): Result text

Esses arquivos são as únicas fontes usadas para derivar os números e conclusões deste artigo.

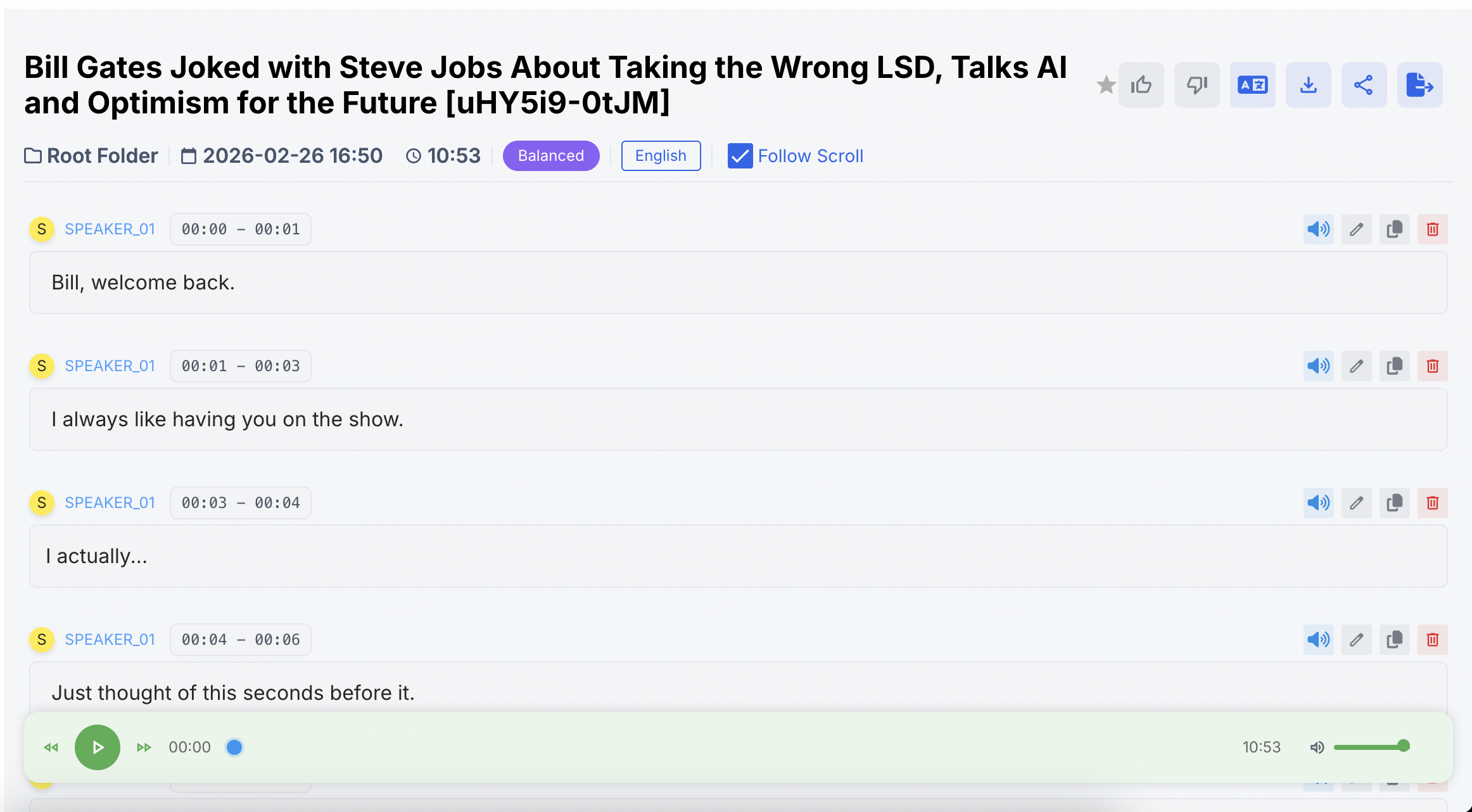

Screenshots from this run

2. Configuração do teste (Testing Setup)

Para esta execução utilizei a seguinte configuração (todos os valores vêm das metainformações pré‑calculadas e de

result.json):- Data da execução: 2026‑02‑26 (derivada dos timestamps de processamento)

- Cenário: entrevista em inglês (

test-transcripts/bill-interview) - Idioma: inglês

- Duração do áudio:

audioDurationSeconds = 653.2934375- ≈ 10,89 minutos de material

- Tempo de processamento:

sttProcessingTimeSeconds = 85.476- ≈ 1,42 minutos de decodificação ponta a ponta

- Modelo / modo:

whisper-model: BASEsaytowords-mode: base

As condições de gravação, o tipo de microfone e a densidade da fala não estão documentados nas metainformações, por isso não faço suposições nem tento preenchê‑las. Todo o alinhamento e o scoring foram feitos antes da redação deste relatório; os valores abaixo são lidos diretamente de

test-transcripts/bill-interview/result.json.3. Metodologia de avaliação (Evaluation Methodology)

A transcrição humana de referência (

ref.vtt) e a saída do modelo (model.vtt) estão em formato WebVTT. O pipeline de avaliação extrai primeiro o texto plano, depois alinha referência e hipótese e, por fim, calcula as métricas de erro.Word Error Rate (WER)

Depois de tokenizar em sequências de palavras, contamos:

- (S): substituições

- (D): deleções (deletions)

- (I): inserções

- (N): número total de palavras de referência

A taxa de erros de palavra é definida por:

[

\text{WER} = \frac{S + D + I}{N}

]

A acurácia em nível de palavra (Accuracy) é:

[

\text{Accuracy} = 1 - \text{WER}

]

Character Error Rate (CER)

Em nível de caractere, espaços são removidos e é calculada uma distância de edição do tipo Levenshtein:

- Distância de edição de caracteres: soma de inserções, deleções e substituições

- Total de caracteres: número de caracteres da referência (sem espaços)

[

\text{CER} = \frac{\text{Character edit distance}}{\text{Total characters}}

]

Real‑Time Factor (RTF)

O throughput é medido com o Real‑Time Factor:

[

\text{RTF} = \frac{\text{Processing Time}}{\text{Audio Duration}}

]

Aqui, o tempo de processamento vem da diferença entre

processtime-at e completed-at em other.yaml, e a duração do áudio de audio-duration no mesmo arquivo.Notas de implementação

- Todas as métricas são calculadas a partir de um alinhamento entre referência e hipótese.

- As distâncias de edição (em nível de palavra e caractere) usam uma implementação Levenshtein de alto desempenho.

- O motor de alinhamento roda sobre um backend otimizado em C++.

- A complexidade temporal é da ordem de O(nm) para sequências de comprimento (n) e (m).

- Todos os valores em

result.jsonsão determinísticos e reproduzíveis: mesmas entradas ⇒ mesmos resultados.

4. Visão geral do modelo (Model Overview)

Neste benchmark foi avaliada apenas uma configuração de modelo:

- Whisper BASE (saytowords-mode: base)

Um modelo de reconhecimento de fala de uso geral, com capacidade média, projetado para inglês multi‑sotaque e áudio de longa duração. Aqui ele é usado “como vem” (sem fine‑tuning e sem correção manual) para observar o comportamento bruto em um cenário real de entrevista.

Comparações futuras podem incluir variantes menores ou maiores do Whisper, além de sistemas não baseados em Whisper, mas este artigo se concentra em caracterizar essa única baseline.

5. Resultados (a partir de result.json)

Os seguintes valores são extraídos diretamente de

test-transcripts/bill-interview/result.json:- Duração do áudio (s):

653.2934375 - Tempo de processamento (s):

85.476 - Palavras de referência (N):

1846 - Substituições (S):

67 - Deleções (D):

178 - Inserções (I):

23 - WER:

0.14517876489707476 - Accuracy:

0.8548212351029252 - Caracteres de referência:

7335 - Distância de edição de caracteres:

825 - CER:

0.11247443762781185 - RTF:

0.13083860191079907

Reescrevendo de forma mais legível:

- WER ≈ 14,52 %

- Accuracy ≈ 85,48 %

- CER ≈ 11,25 %

- RTF ≈ 0,13, ou seja, cerca de 7,6× mais rápido que em tempo real.

6. Análise do padrão de erros (Error Pattern Analysis)

Não há marcações de erro por segmento nem visualizações dedicadas; a análise se baseia inteiramente nos totais agregados.

-

Tipo de erro dominante: deleções (deletions)

- Deleções:

D = 178 - Substituições:

S = 67 - Inserções:

I = 23

As deleções representam a maior parte dos erros em nível de palavra. Isso indica que o modelo tende a deixar palavras de fora com mais frequência do que inventar conteúdo. Em uma entrevista, isso geralmente significa perder palavras funcionais, caudas de frases em fala rápida ou partes sobrepostas da fala que são resolvidas por omissão.

- Deleções:

-

Substituições existem, mas são secundárias

ComS = 67, as substituições representam aproximadamente um quarto de todos os erros. Normalmente correspondem a confusões lexicais: palavras de som parecido, nomes próprios mal reconhecidos ou termos de domínio pouco frequentes para o modelo. -

Inserções são relativamente raras

Observam‑se apenasI = 23inserções. Isso é consistente com um modelo conservador em relação a alucinações de conteúdo: ele erra mais por omissão do que por adição.

Em nível de caractere:

- Distância de edição de caracteres = 825 em 7335 caracteres, resultando em CER ≈ 11,25 %.

Em comparação com uma WER de ~14,5 %, essa CER mais baixa sugere que muitas palavras incorretas permanecem próximas da referência em nível de caracteres — por exemplo, pequenas variações de flexão, erros ortográficos leves ou palavras compostas quebradas/juntas de forma diferente.

Sem marcações de erro alinhadas a timestamps, não é possível apontar «o minuto exato em que o modelo falhou». Ainda assim, a decomposição S/D/I já revela um perfil claro: o sistema tende a subtranscrever (under‑transcribe) mais do que a inventar trechos que não existem.

7. Principais insights (Key Insights)

Com base apenas nos números, podemos destacar alguns pontos:

-

Bom equilíbrio entre velocidade e precisão para entrevistas

Com RTF ≈ 0,13, o sistema processa ~10,9 minutos de áudio em ~1,4 minuto, mantendo WER ≈ 14,5 % e CER ≈ 11,3 %. Para processamento em lote de entrevistas, esse ponto de operação é bastante prático. -

Padrão de erro fortemente dominado por deleções

Deleções (178) dominam sobre substituições (67) e inserções (23). Na prática, isso significa que você está mais sujeito a perder pequenos trechos de conteúdo do que ver o modelo inventar frases inteiras. -

Maior estabilidade em nível de caractere do que de palavra

O fato de a CER ser menor que a WER indica que muitas palavras incorretas ainda são próximas da referência em nível de caracteres. Isso é positivo para tarefas como busca e agrupamento temático, que toleram variações lexicais leves. -

Volume de fala não trivial

Com 1846 palavras de referência e 7335 caracteres, este cenário se aproxima de uma entrevista real, e não de um exemplo de brinquedo. As métricas refletem o comportamento do modelo ao longo de vários minutos de fala espontânea.

8. Melhor modelo para este cenário (Best Model for This Scenario)

Neste benchmark foi testado apenas Whisper BASE (modo base), o que faz dele simultaneamente:

- o modelo mais forte do «quadro», e

- o único ponto de comparação.

Nesse contexto, ele entrega:

- WER ≈ 14,5 %, Accuracy ≈ 85,5 % em ~11 minutos de áudio de entrevista.

- RTF ≈ 0,13, isto é, 7–8× mais rápido que em tempo real.

Para fluxos de trabalho que exigem transcrições de entrevistas rápidas e razoavelmente precisas — para navegação, busca ou citações aproximadas — essa configuração é numericamente adequada. Para cenários em que cada palavra precisa ser perfeita, as métricas deixam claro que ainda é necessária revisão humana ou um modelo mais forte.

9. Veredito final neutro (Neutral Final Verdict)

Nesta entrevista em inglês de 26 de fevereiro de 2026, o Whisper BASE em modo “base” apresenta:

- um perfil de erro dominado por deleções, com poucas inserções,

- uma WER nos médios 10 e poucos por cento e uma CER nos baixos 10 e poucos por cento, sustentadas por uma transcrição de referência não trivial,

- um Real‑Time Factor em torno de 0,13, adequado a processamento em lote em grande escala.

O comportamento é numericamente consistente, reproduzível e rápido o suficiente para servir como infraestrutura de benchmark diário. Para um avaliador independente, a conclusão é direta: esta configuração é uma baseline viável para transcrição de entrevistas, mas ainda não substitui a revisão humana em domínios altamente sensíveis.

Artefatos de referência (Reference Artifacts)

A seguir estão estruturas dobráveis para a transcrição de referência e a transcrição do modelo. Você pode colar nelas o conteúdo completo dos arquivos VTT quando quiser.

ref.vtt (transcrição de referência)

<!-- Cole aqui o conteúdo completo de test-transcripts/bill-interview/ref.vtt -->

model.vtt (transcrição do modelo)

<!-- Cole aqui o conteúdo completo de test-transcripts/bill-interview/model.vtt -->