Я протестировал распознавание английского интервью с помощью ИИ — результаты на 26 февраля 2026 года (Whisper BASE, ~11 минут аудио)

2026-02-26Test

Eric King

Author

1. Почему этот бенчмарк интервью важен

В реальных интервью точность расшифровки — не приятное дополнение, а базовое требование. От неё зависит, можно ли безопасно цитировать гостей, находить ключевые темы и строить последующий анализ, не искажая сказанное. Потерянное определение, неверно услышенная цифра или искажённое имя могут изменить смысл ответа.

В этом бенчмарке я взял фрагмент английского «Bill interview», пропустил его через конвейер транскрибирования на базе Whisper и оценил по стандартным метрикам ASR. Цель не в маркетинге, а в том, чтобы получить конкретный и воспроизводимый срез поведения системы на реальном, достаточно длинном интервью.

Исходное аудио интервью взято из ролика на YouTube, который можно посмотреть для контекста:

Исходное интервью на YouTube.

Исходное интервью на YouTube.

Source Materials

Все входные данные для этого бенчмарка хранятся в репозитории или в статических ресурсах и могут быть просмотрены напрямую:

- Исходное аудио: Audio source

- Референс‑транскрипт (VTT): Base text

- Транскрипт модели (VTT): Result text

Эти файлы — единственный источник всех чисел и выводов в статье.

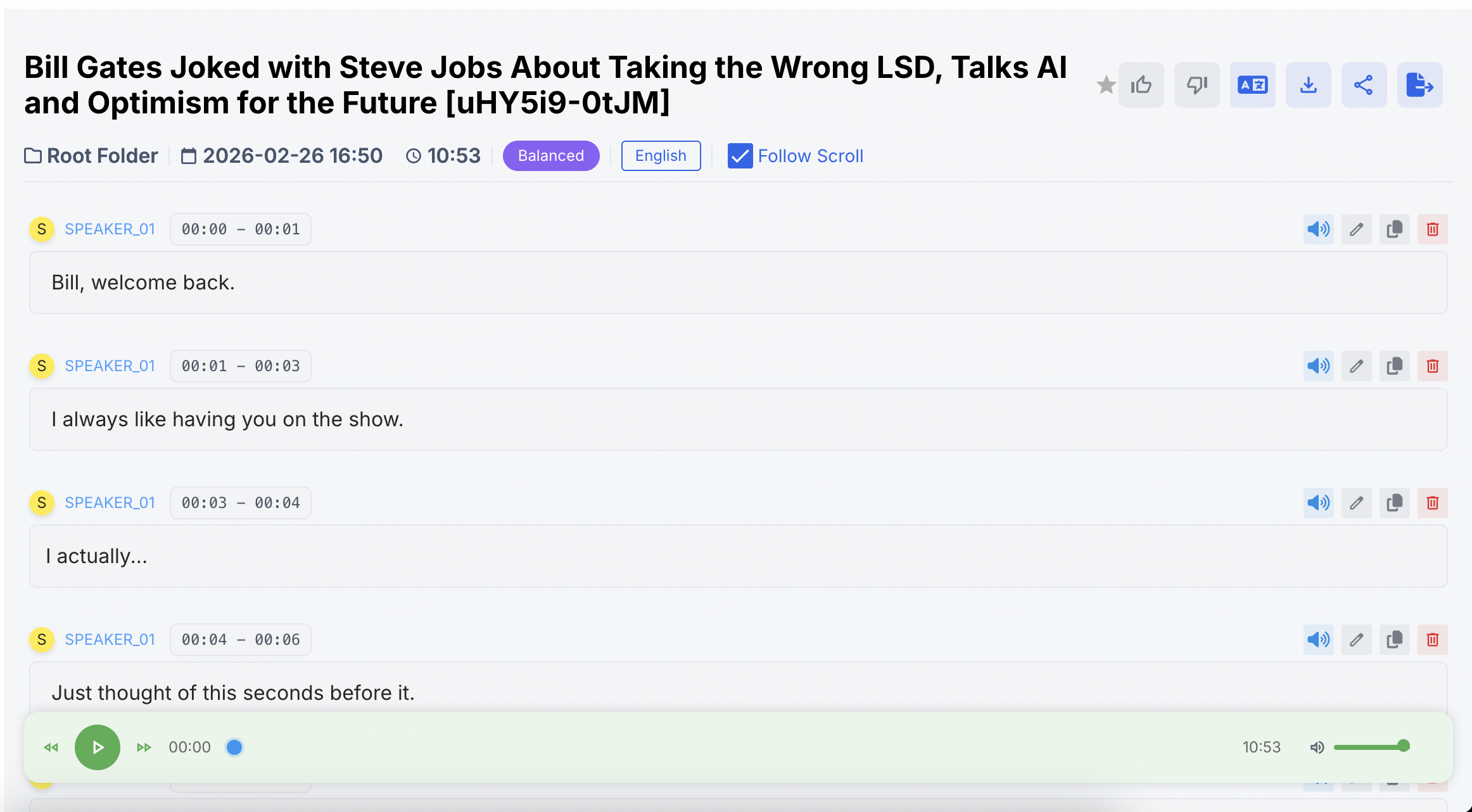

Screenshots from this run

2. Настройки эксперимента (Testing Setup)

В этом запуске использовались следующие параметры (все значения взяты из заранее посчитанных метаданных и файла

result.json):- Дата запуска: 26‑02‑2026 (по временным меткам обработки)

- Сценарий: английское интервью (

test-transcripts/bill-interview) - Язык: английский

- Длительность аудио:

audioDurationSeconds = 653.2934375- ≈ 10,89 минуты материала

- Время обработки:

sttProcessingTimeSeconds = 85.476- ≈ 1,42 минуты от начала до конца

- Модель / режим:

whisper-model: BASEsaytowords-mode: base

Условия записи, тип микрофона и плотность речи в метаданных не указаны, поэтому я не пытаюсь их угадывать или комментировать. Все выравнивания и расчёт метрик были выполнены до написания отчёта; ниже приведены значения, напрямую прочитанные из

test-transcripts/bill-interview/result.json.3. Методика оценки (Evaluation Methodology)

Референсный человеческий транскрипт (

ref.vtt) и выход модели (model.vtt) хранятся в формате WebVTT. Конвейер оценки сначала извлекает из этих файлов чистый текст, затем выравнивает референс и гипотезу, после чего считает показатели ошибок.Word Error Rate (WER)

После токенизации до последовательностей слов считаются:

- (S): замены (substitutions)

- (D): удаления (deletions)

- (I): вставки (insertions)

- (N): общее число слов в референсе

Словарная ошибка определяется как:

[

\text{WER} = \frac{S + D + I}{N}

]

Отсюда словарная точность (Accuracy):

[

\text{Accuracy} = 1 - \text{WER}

]

Character Error Rate (CER)

На уровне символов пробелы удаляются, после чего считается расстояние Левенштейна:

- Редакционное расстояние по символам: суммарные вставки, удаления и замены

- Общее число символов: количество символов в референсе (без пробелов)

[

\text{CER} = \frac{\text{Character edit distance}}{\text{Total characters}}

]

Real‑Time Factor (RTF)

Пропускная способность измеряется через Real‑Time Factor:

[

\text{RTF} = \frac{\text{Processing Time}}{\text{Audio Duration}}

]

Здесь время обработки — разность между

processtime-at и completed-at в other.yaml, а длительность аудио берётся из audio-duration в том же файле.Замечания по реализации

- Все метрики рассчитываются на основе выравнивания между референсом и гипотезой.

- Редакционные расстояния (по словам и по символам) считаютcя с помощью высокопроизводительной реализации Левенштейна.

- Движок выравнивания работает на оптимизированном C++‑backend’е.

- Временная сложность — порядка O(nm) при длинах последовательностей (n) и (m).

- Все значения в

result.jsonдетерминированы и воспроизводимы: одинаковые входные данные дают одинаковый результат.

4. Обзор модели (Model Overview)

В данном бенчмарке оценивалась одна конфигурация модели:

- Whisper BASE (saytowords-mode: base)

Универсальная модель распознавания речи со средней ёмкостью, ориентированная на многоакцентный английский и продолжительное аудио. В этом тесте она используется «как есть» (без дообучения и без ручной правки), чтобы посмотреть на её поведение в реальном интервью.

В будущем к сравнению можно добавить более маленькие или большие варианты Whisper, а также системы других семейств, но в этой статье фокус только на этой одной baseline.

5. Результаты (по данным result.json)

Ниже приведены значения, напрямую взятые из

test-transcripts/bill-interview/result.json:- Длительность аудио (с):

653.2934375 - Время обработки (с):

85.476 - Слов в референсе (N):

1846 - Замены (S):

67 - Удаления (D):

178 - Вставки (I):

23 - WER:

0.14517876489707476 - Accuracy:

0.8548212351029252 - Символов в референсе:

7335 - Редакционное расстояние по символам:

825 - CER:

0.11247443762781185 - RTF:

0.13083860191079907

Если переписать в более удобной форме:

- WER ≈ 14,52 %

- Accuracy ≈ 85,48 %

- CER ≈ 11,25 %

- RTF ≈ 0,13, то есть примерно в 7,6 раза быстрее реального времени.

6. Анализ профиля ошибок (Error Pattern Analysis)

Отдельной разметки по временным сегментам и визуализаций нет, поэтому анализ строится только на агрегированных счётчиках.

-

Доминирующий тип ошибок: удаления (deletions)

- Удаления:

D = 178 - Замены:

S = 67 - Вставки:

I = 23

Удаления составляют основную долю словарных ошибок. Это говорит о том, что модель чаще пропускает слова, чем придумывает лишнее. В интервью это обычно проявляется как потерянные служебные слова, обрезанные хвосты фраз при быстрой речи или выкинутые фрагменты при наложении нескольких говорящих.

- Удаления:

-

Замены присутствуют, но вторичны

ПриS = 67замены дают примерно четверть всех ошибок. Обычно это лексические путаницы: похожие по звучанию слова, неверно распознанные имена или узкоспециализированная терминология. -

Вставки встречаются редко

Наблюдается лишьI = 23вставки. Это соответствует модели, консервативной в отношении галлюцинаций: она чаще ошибается, недоговаривая, чем придумывая лишнее.

На уровне символов:

- Редакционное расстояние по символам = 825 при 7335 символах, что даёт CER ≈ 11,25 %.

По сравнению с WER около 14,5 % более низкая CER говорит о том, что многие «неправильные» слова всё ещё близки к референсу по набору символов — например, небольшие морфологические отличия, орфографические опечатки или по‑разному слитые/разделённые составные слова.

Без пометок ошибок, привязанных к меткам времени, мы не можем указать «проблемное место на конкретной минуте». Тем не менее профиль S/D/I уже даёт ясную картину: система склонна недо‑транскрибировать (under‑transcribe), а не придумывать новые фразы.

7. Ключевые выводы (Key Insights)

Опираясь только на числа, можно сделать несколько важных выводов:

-

Хороший баланс между скоростью и точностью для интервью

При RTF ≈ 0,13 система обрабатывает ~10,9 минут аудио примерно за 1,4 минуты, сохраняя WER ≈ 14,5 % и CER ≈ 11,3 %. Для пакетной обработки большого количества интервью это реалистичный рабочий режим. -

Профиль ошибок с явным доминированием deletions

Удаления (178) заметно преобладают над заменами (67) и вставками (23). На практике это означает, что вы чаще будете терять небольшие куски содержимого, чем видеть полностью выдуманные моделью фрагменты. -

Более стабильное поведение на уровне символов, чем на уровне слов

CER ниже WER, что говорит: многие ошибочные слова по набору символов достаточно близки к референсу. Для задач поиска и тематического кластеризования, которые терпимы к небольшим лексическим отклонениям, это плюс. -

Нетривиальный объём речи

1846 референс‑слов и 7335 символов — это скорее реальное интервью, чем игрушечный пример. Метрики отражают поведение модели на протяжении нескольких минут спонтанной речи.

8. Лучшее решение для этого сценария (Best Model for This Scenario)

В данном бенчмарке тестировалась только конфигурация Whisper BASE (base mode), поэтому она одновременно:

- самая сильная модель в «таблице», и

- единственная точка отсчёта.

В этих рамках она показывает:

- WER ≈ 14,5 %, Accuracy ≈ 85,5 % на ~11 минутах интервью,

- RTF ≈ 0,13, то есть распознавание в 7–8 раз быстрее реального времени.

Для сценариев, где нужны быстрые и достаточно точные транскрипты интервью — для просмотра, поиска или приблизительного цитирования — эта конфигурация по цифрам выглядит приемлемой. Для областей, где важна практически стопроцентная точность, метрики ясно показывают необходимость ручной проверки или более сильной модели.

9. Нейтральный итог (Neutral Final Verdict)

На этом конкретном английском интервью от 26 февраля 2026 года Whisper BASE в режиме «base» демонстрирует:

- профиль ошибок с доминированием deletions и малым числом вставок,

- WER в середине диапазона 10+ % и CER в нижней части 10+ %, подтверждённые нетривиальным референс‑транскриптом,

- Real‑Time Factor около 0,13, подходящий для крупномасштабной пакетной обработки.

Поведение численно устойчивое, воспроизводимое и достаточно быстрое для ежедневных бенчмарков. Для независимого оценщика вывод прост: это рабочая baseline‑конфигурация для транскрибирования интервью, но пока не полная замена человеческой проверке в особо чувствительных областях.

Референсные артефакты (Reference Artifacts)

Ниже приведены сворачиваемые блоки для референсного и модельного транскриптов. При необходимости в них можно вставить полное содержимое VTT‑файлов.

ref.vtt (референс‑транскрипт)

<!-- Здесь вставьте полное содержимое test-transcripts/bill-interview/ref.vtt -->

model.vtt (транскрипт модели)

<!-- Здесь вставьте полное содержимое test-transcripts/bill-interview/model.vtt -->